作者:电子创新网编辑部

在硅谷,几乎每周都有新的AI芯片故事上演。但今天这家刚结束隐身期的公司,讲的故事有点“反直觉”。

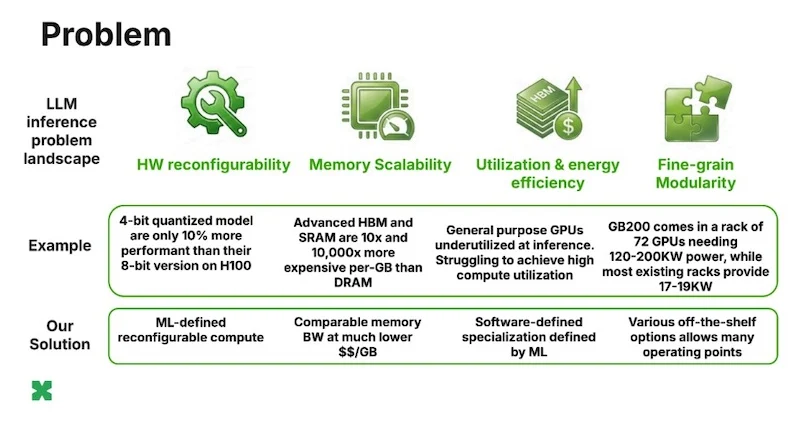

ElastixAI,一家总部位于西雅图的初创公司,今天正式亮牌。他们的核心主张很直接:在大语言模型(LLM)推理这件事上,大家追捧的英伟达GPU可能从一开始就“用错了力”。他们拿出的方案是基于FPGA的软硬协同设计,宣称能把推理的总拥有成本(TCO)压低50倍,功耗砍掉80%。

这数字听着像PPT造车?我们先别急着下结论,看看背后的逻辑。

训练是算力的游戏,推理是内存的博弈

ElastixAI的三位创始人——CEO Mohammad Rastegari、CTO Saman Naderiparizi和CSO Mahyar Najibi,履历都很硬。Rastegari曾是Xnor.ai联合创始人(后被苹果收购),也在Meta主导过Llama 405B的推理优化;Najibi参与过Apple Intelligence项目,还做过Waymo的首席科学家。

这群人最清楚大模型落地时的痛点。Rastegari在专访里说了一句很实在的话:“训练是计算瓶颈(compute-bound),推理是内存瓶颈(memory-bound)。”

这话什么意思?简单说,训练大模型时,数据要在矩阵里反复算,GPU那成千上万个核心能跑满,效率很高。但到了推理阶段,尤其是生成式AI,大部分时间花在把模型权重从内存搬到计算单元上,计算单元反而在“等数据”。

这时候,你让为高强度并行计算设计的GPU去干这个活,就像开法拉利送外卖——引擎厉害,但路况(内存带宽)限制了速度,大部分算力都在空转。

更麻烦的是硬件的僵化。比如现在流行的4-bit量化,理论上能让吞吐翻倍,但在H100这种缺乏原生支持的硬件上,靠软件绕路实现,实际只能发挥出10%的潜力。

为什么不做ASIC?因为AI变得太快

既然GPU不合适,那定制ASIC(专用芯片)行不行?这是过去几年很多芯片创业公司的选择,也是ElastixAI刻意回避的路。

“机器学习的演进速度,远快于芯片开发周期。”Rastegari拿Mixture-of-Experts (MoE) 架构举例:很多公司照着当时的主流架构流片,结果MoE突然火了,原本设计的硅片瞬间过时,只能回炉重造。

ASIC从设计到量产要三年,而AI领域的范式转移可能只要几个月。几年前每秒20个token够用,现在“推理型”模型要求每秒200个token。一旦流片,就没了回头路。

FPGA的优势就在这儿:它能重新配置。Transformer架构本身已经相对稳定,适合在FPGA上固化;但底层的量化、稀疏化等优化技术还在快速迭代,FPGA能跟着变。

ElastixAI的策略很务实:不自己造芯片,而是买现成的FPGA服务器,通过自研的软件栈做深度优化。他们不拼最贵的HBM,而是算“单位带宽成本”和“单位容量成本”,用性价比更高的DDR和HBM组合,把硬件潜力榨干。

不用液冷,风冷机架就能跑

对于数据中心运营者来说,ElastixAI的方案还有一个诱人的点:不用搞液冷。

现在的英伟达GB200 NVL72系统,一个机架功率高达120-200kW,必须上液冷,这对现有数据中心简直是灾难。而ElastixAI的Elastix Rack兼容标准的17-19kW风冷机架。

CTO Naderiparizi给出的数据是:在同等吞吐下,每生成一个token的能耗降低约5倍。这意味着,现有的机房不用大改,不用扩容电力,不用铺水管,直接把GPU服务器换掉一部分,就能跑起来。

这对于那些已经被高昂电费和改造成本压得喘不过气的云厂商和企业来说,吸引力不小。

生态怎么破?先让开发者无感迁移

当然,挑战英伟达,技术只是第一步,生态才是护城河。ElastixAI很清楚这一点。

他们没有另搞一套开发环境,而是做了个vLLM插件,直接替换CUDA后端,前端API保持和OpenAI兼容。对应用开发者来说,代码不用改;对运维来说,堆栈不用动。

未来,他们还打算把模型转换工具链开放给研究人员。这招很像早期英伟达推CUDA的路子:先让学术界和开发者用起来,形成习惯,最后反哺生态。

2026年中出货,赌的是AI下半场的“性价比”

ElastixAI在2025年5月完成了1800万美元的种子轮,由Fuse VC领投。首批硬件预计2026年年中出货。

这个时间点很有意思。2026年,AI行业大概率已经从“不计成本抢算力”进入“精打细算拼落地”的阶段。当大模型的能力差距逐渐缩小,谁能以更低的成本、更少的能耗稳定输出Token,谁就能活下去。

ElastixAI赌的就是这个趋势:GPU继续垄断训练市场,而推理市场,或许该换个玩法了。

不管最终能不能真做到50倍的成本降低,至少它给行业提了个醒:在生成式AI的赛道上,盲目堆砌算力已经不是唯一解,架构的匹配度和能效比,才是接下来几年的关键考题。

对于那些看着GPU账单发愁的企业来说,多一个选项,总比没有好。

* 本文为原创文章,转载需注明作者、出处及原文链接,否则,本网站将保留追究其法律责任的权利。