本文转载自: XILINX开发者社区微信公众号

本文投稿作者: zst123 (github.com/zst123)

信息通信和电子爱好者, 热衷于钻研新技术。

使用 Ultra96-V2 进行边缘 AI 和图像处理的分布式移动办公办公室管理可扩展解决方案。

项目简介

在这个项目中,我将创建一款用于智能办公室移动办公布局的应用。

现代办公室正在广泛采用“移动办公”的概念。通过“先到先得”的方式能够更有效地利用共享的空间和办公桌。然而,其中面临的问题在于,员工可能会浪费更多时间来寻找空置的办公桌。此外,跟踪占用率并在预订就系统中进行更新的工作也很单调乏味。借助基于边缘的图像处理功能,我们能够检测区域内的人员并确定办公桌是否被占用。

在技术方面,我将使用 Ultra96-V2 演示 Vitis AI 模型库和面向 PYNQ 的 DPU IP 核的编译流程。我将从零开始进行编译,这样将更方便在以后修改硬件设计,我感觉获取环境设置的过程有些混乱,所以我会为大家一步一步地进行记录。

PYNQ & Vitis AI 工作流程说明

在开始之前,有一点很重要,我们需要知道 Ultra96-V2 使用的是赛灵思 Zynq UltraScale+™ MPSoC。我们可以把它称为基于 ARM 的 FPGA,这意味着它既包含处理系统 (PS),也包含可编程逻辑 (PL)。

我将会使用 PYNQ,我们需要制作在 PS 上运行的 Python 脚本。使用预编译的 PYNQ 叠加(或比特流),我们可以在 PL 中配置深度学习处理器单元 (DPU)。在 PS 上运行的软件可以使用 DPU 来加速图像识别任务。

使用的额外硬件

除了 Ultra96-V2 软件包以外,您可能还需要以下这些额外的硬件。

1.USB 摄像头

2.有源 Mini-DisplayPort 适配器

请注意:如果您有预算限制,可以不用这些。

例如,可以使用 IP 摄像头作为替代, 有一些应用可以将您的智能手机用作 IP 摄像头。如果您使用 USB 或远程 SSH 进行连接,则可能不需要 mini-DP 适配器。

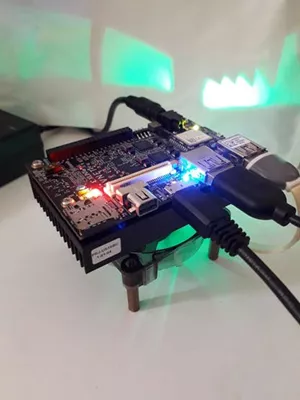

1 / 2 • Logitech C170 USB 摄像头

准备 PYNQ 镜像

我们首先将 PYNQ 加载到电路板上,并做一些测试。您可以从从官方网站下载 Avnet Ultra96-V2 v2.5 PYNQ 镜像。

您可以在社区版块下面找到它。

根据这些说明将镜像写入 SD 卡中。

https://pynq.readthedocs.io/en/latest/appendix.html#writing-the-sd-card

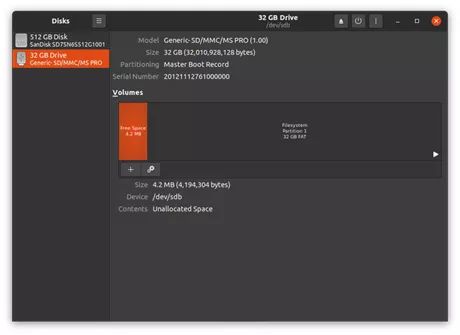

插入您的 SD 卡,在 Ubuntu 上,您将能够在磁盘 应用中看到您安装的主板。

在这种情况下,器件名称是 /dev/sdb

卸载分区:

$ umount /dev/sdb

在处理下一个命令的器件名称时要非常小心,我们将要使用 PYNQ 镜像覆盖 SD 卡内容。

您可以使用 dd 命令将 PYNQ 镜像写入 SD 卡中,我决定使用 dcfldd 来显示进度:

$ sudo dcfldd bs=4M if=ultra96v2_v2.5.img of=/dev/sdb 1536 blocks (6144Mb) written. 1574+1 records in 1574+1 records out

启动 PYNQ

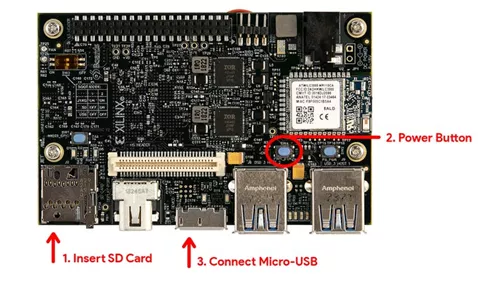

插入 SD 卡并按下电源按钮,以启动电路板。

将 Micro USB 电缆从您的 PC 连接到 Ultra96-V2,您将在您的 PC 上看到一个新的以太网接口。

您现在可以通过此链接在浏览器中访问 Jupyter Notebook http://192.168.2.1:9090

如果需要密码,那就是“xilinx”

连接到 WiFi

我们需要将电路板连接到 Wifi,因为我们将下载一些东西。如果您有 USB-to-Ethernet 适配器,您也可以使用它,并跳过这个部分。

带有脚本的 Jupyter Notebook 可以帮助您连接到 Wifi。导航到

notebooks/common/wifi.ipynb,在这里您可以将脚本修改为您自己的 Wifi 凭证。

或者,如果您熟悉 Linux 系统,您也可以发出以下命令:

# Scan Wifi $ ifconfig wlan0 up $ iwlist wlan0 scan # Connect to WEP access point $ iwconfig wlan0 essid "YOUR_SSID_NAME" key s:YOUR_PASSWORD # Connect to WPA access point $ wpa_passphrase YOUR_SSID_NAME YOUR_PASSWORD > /etc/wpa_supplicant.conf $ sudo wpa_supplicant -c /etc/wpa_supplicant.conf -i wlan0 -B

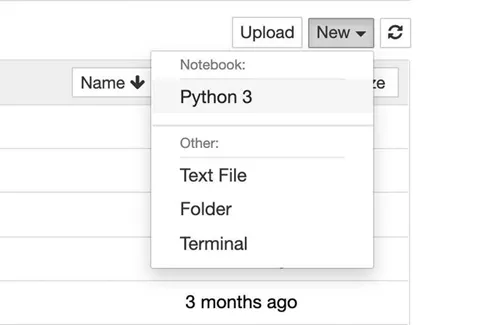

在这里,我们可以从 Web 界面打开一个新的终端:

使用 Vitis AI 升级到最新的PYNQ

在后续步骤中,我们将在终端中发出一些命令,以便下载和安装大量软件包, 这估计需要 1 个小时的时间。

我建议安装 USB 风扇或任何散热装置,因为 Ultra96-V2 会变得非常得烫手。当它很热时,处理器将开始减少热量并减慢进程。

1 / 2

从 Jupyter Notebooks 打开终端。

从 Github Repo 下载并编译 Vitis AI PYNQ DPU。这个步骤是使用 Vitis-AI 来升级 PYNQ(可能需要大约一个小时才能完成):

$ git clone --recursive --shallow-submodules https://github.com/Xilinx/DPU-PYNQ.git $ cd DPU-PYNQ/upgrade $ make

安装 pynq-dpu python 包:

pip3 install pynq-dpu

将 pynq-dpu notebooks 下载到您的主文件夹中

cd $PYNQ_JUPYTER_NOTEBOOKS pynq get-notebooks pynq-dpu -p .

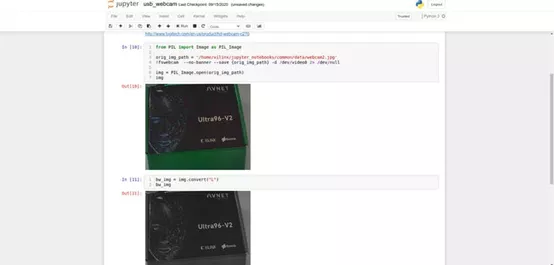

测试 USB 网络摄像头功能

连接您的 USB 网络摄像头并测试功能:

这里我使用的是 Logitech C170,PYNQ 可以自动检测到它,您可以使用此命令进行确认。

$ lsusb Bus 001 Device 004: ID 046d:082b Logitech, Inc. Webcam C170

在 Jupyter 中,通过./notebooks/common/usb_webcam.ipynb 打开 notebook,您可以运行它,以查看您的网络摄像头是否正常工作。

现在,我们已经验证了该电路板功能齐全。我们可以从 Vitis AI 库编译 PYNQ DPU 镜像和模型。

准备编译环境

我们需要安装赛灵思 Vitis 和赛灵思运行时 (XRT) 2020.1 版本。对于 Vitis 和 XRT 2020.1,受支持的最新操作系统是 Ubuntu 18.04.2 LTS。

Ubuntu 20.04 不受支持,所以我无法成功安装。因此,我在虚拟机中安装了所有东西。

虚拟机上的 Ubuntu 18.04.02 LTS

通过此链接下载赛灵思运行时 (XRT) 的 .deb 文件

https://www.xilinx.com/support/download/index.html/content/xilinx/en/dow...

使用此命令来进行安装:

sudo apt install ./xrt_202010.2.6.655_18.04-amd64-xrt.deb

接下来,下载赛灵思统一 Web 安装程序,它将安装 Vitis 2020.1。您需要注册一个赛灵思帐户。请遵循此网站上的说明

https://www.xilinx.com/html_docs/xilinx2020_1/vitis_doc/juk1557377661419...

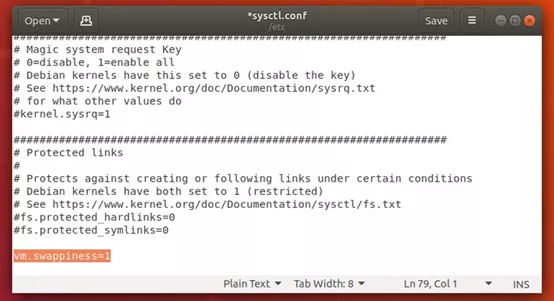

将 swappiness 设置为较低的值也很有帮助,因为构建过程中会使用大量的 RAM。它会告知操作系统在换出到硬盘之前可以使用更多的 RAM。

https://askubuntu.com/questions/103915/how-do-i-configure-swappiness

如需更改系统 swappiness 值,通过 root 权限打开 /etc/sysctl.conf

sudo gedit /etc/sysctl.con

然后,通过添加此行来更改 swappiness。我选择将该值设置为 1。这意味着在将 RAM 交换到硬盘之前,系统将使用高达 99% 的 RAM(剩余 1%)。

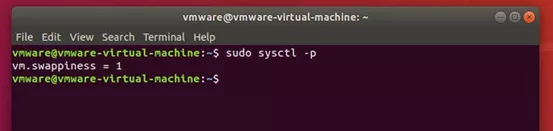

应用更改。

sudo sysctl -p

现在我们准备开始编译……

Ultra96-V2 编译 DPU-PYNQ

我们将仔细参考本指南:https://github.com/Xilinx/DPU-PYNQ/blob/master/boards/README.md

首先,从赛灵思 DPU-PYNQ 库中复制构建文件

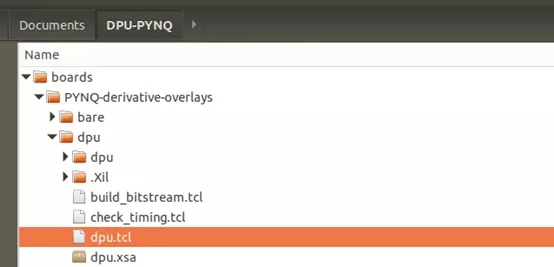

git clone --recursive --shallow-submodules https://github.com/Xilinx/DPU-PYNQ.git cd DPU-PYNQ/boards

我们必须对构建文件进行一些更改,因为它们最初是在 Vitis 2019.2 中设计的,但现在我们正在使用新版本进行编译。

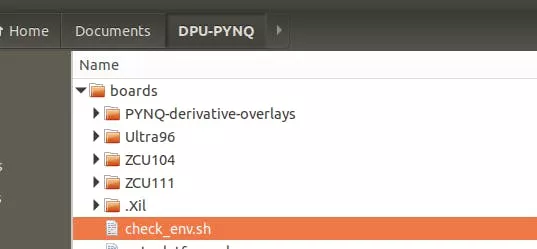

在 boards 文件夹中,编辑 check_env.sh

搜索 2019.2,将其改为 2020.1

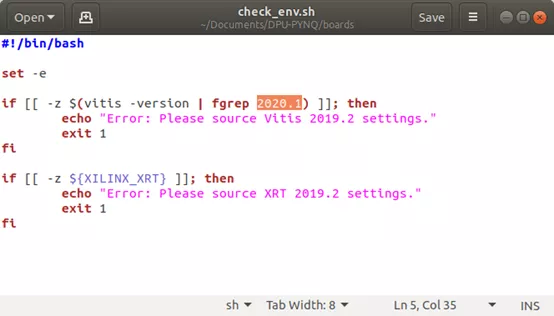

同样转至 /vitis-ai-git/DPU-TRD/dpu_ip/dpu_eu_v3_2_0,并编辑 component.xml

搜索 2019.2,将其改为 2020.1

最后,如果您想对 DPU IP 配置进行任何更改,请转至 boards/Ultra96/dpu_conf.vh。

在这个案例中,我将存储器更改为 RAM_USAGE_HIGH。

我们准备好开始编译了:

打开一个终端,并获取赛灵思工具

source /opt/Xilinx/Vitis/2020.1/settings64.sh source /opt/xilinx/xrt/setup.sh

开始编译(请注意: Ultra96 和 Ultra96-V2 可以使用相同的方法)

$ make BOARD=Ultra96

过了一段时间后,构建再次失败了,因为它检查到版本是 2019.2,而不是 2020.1。

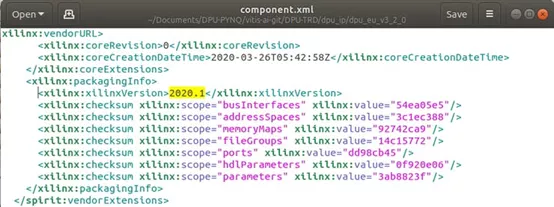

查看 DPU-PYNQ/boards 目录。这是因为有一个名为 PYNQ-derivative-overlays 的新文件夹。构建脚本复制了另一个名为 PYNQ-derivative-overlays 的存储库。它负责将 DPU IP 置于 PYNQ 基础叠加之上。

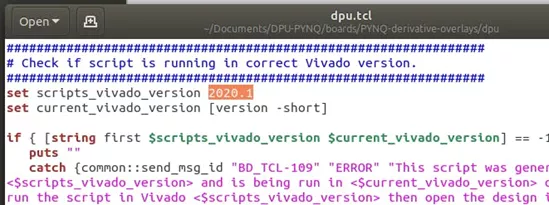

转至 PYNQ-derivative-overlays/dpu/ 并编辑 dpu.tcl

同样地,将 2019.2 更改为 2020.1

然后继续制作过程。

$ make BOARD=Ultra96

综合过程所花的时间最长,可能需要一个小时

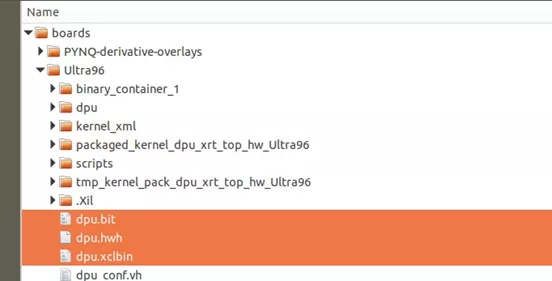

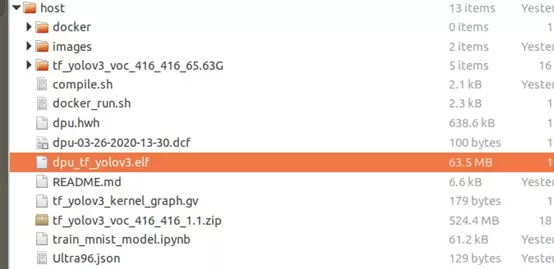

完成后,您将看到以下文件, 这些文件是面向 PYNQ 的比特流叠加。

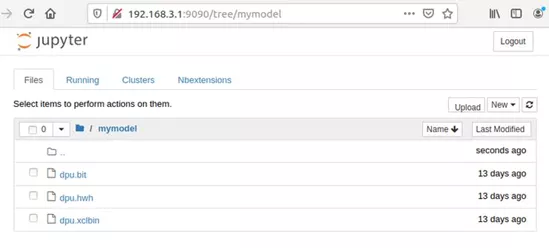

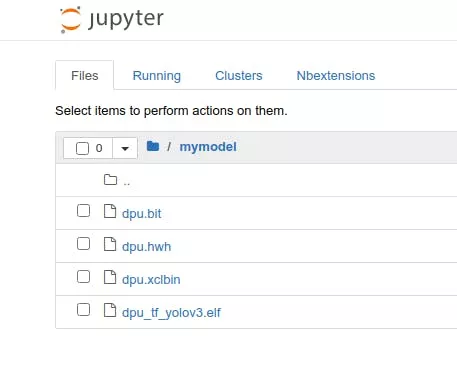

我会将这些文件上传到 Juypyter 实例中,放在一个名为 mymodel 的文件夹中。

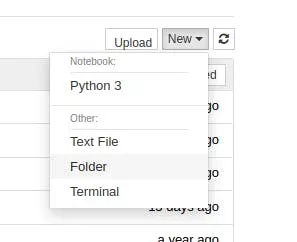

在右上角,单击“新建 > 文件夹”

然后在文件夹中,单击“上传”并选择 3 个文件。

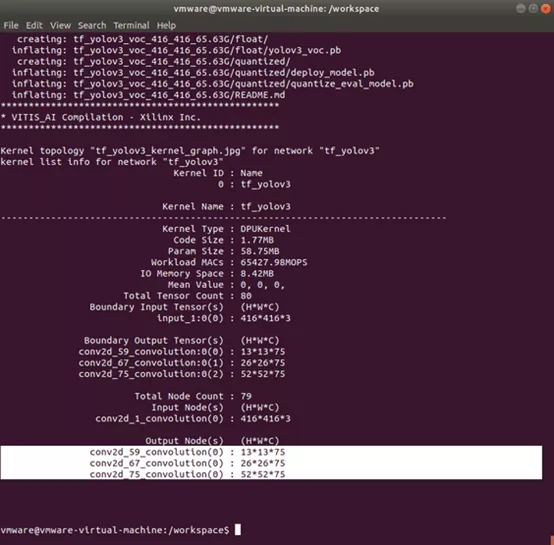

从 Vitis 模型库编译 YoloV3

请注意:模型是特定于您编译的 DPU(即一种 DPU 配置的模型与另一种不兼容)。例如,这意味着如果您更改编译时使用的内核数量,您还必须重新编译模型。

准备 docker 文件

cd DPU-PYNQ/host mkdir -p docker cp -rf ../vitis-ai-git/docker_run.sh . cp -rf ../vitis-ai-git/docker/PROMPT.txt docker chmod u+x docker_run.sh

安装 docker

sudo apt install docker -y sudo groupadd docker newgrp docker

运行 docker 实例

./docker_run.sh xilinx/vitis-ai-cpu:latest

进入实例后,您可以编译模型

cp ../boards/Ultra96/dpu.hwh ./ ./compile.sh Ultra96 tf_yolov3_voc_416_416_65.63G_1.1

完成后,您将在目录中看到模型 dpu_tf_yolov3.elf

也将其上传到您的 Jupyter 实例:

Notebook 示例

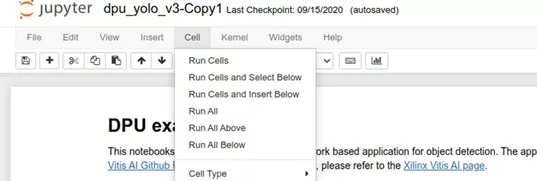

pynq_dpu/dpu_yolo_v3.ipynb 中有一个示例,它可以测试 YoloV3 模型

现在制作副本(文件 > 制作副本),并修改代码以指向 mymodel 文件夹,其中包含我们自己编译的比特流和模型

运行所有单元(单元 > 运行所有)

验证镜像已经分类成功

我们终于准备好创建我们的应用了!

应用代码

最后,在完成了所有的硬件设置和测试后,我编写了软件代码来创建我自己的智能办公室移动办公应用。

它由 2 个并行运行的 Jupyter Notebooks 组成。第一个负责设置 PYNQ 叠加和处理视频馈送。第二个将利用数据显示基于座位可用性的控制面板。这个演示视频展示了它的外观:

结论

我希望这篇文章对您来说已经足够全面详细了。这是我第一次使用赛灵思硬件来了解边缘上的 FPGA 和 AI。因此,在开始时,最难的部分是使用开发工具和适应环境,因此,我尽力详细地展示了尽可能多的设置过程。感谢您阅读完全文!

更多资料请查阅:

原理图-框图

代码: Github Repo

https://github.com/zst123/Xilinx_Smart-Office-Hot-Desking

硬件组件

Avnet Ultra96-V2 ×1

Logitech C170 网络摄像头 ×1

软件应用和在线服务