赛灵思 Vitis AI 是一款功能强大的机器学习开发平台,用于在赛灵思自适应计算平台上实现 AI 推断加速。最新发布的 Vitis AI 1.4 版本为用户提供了完整的解决方案堆栈,首次实现了对最新 7nm Versal ACAP 平台和16nm Kria™ SOM的支持。

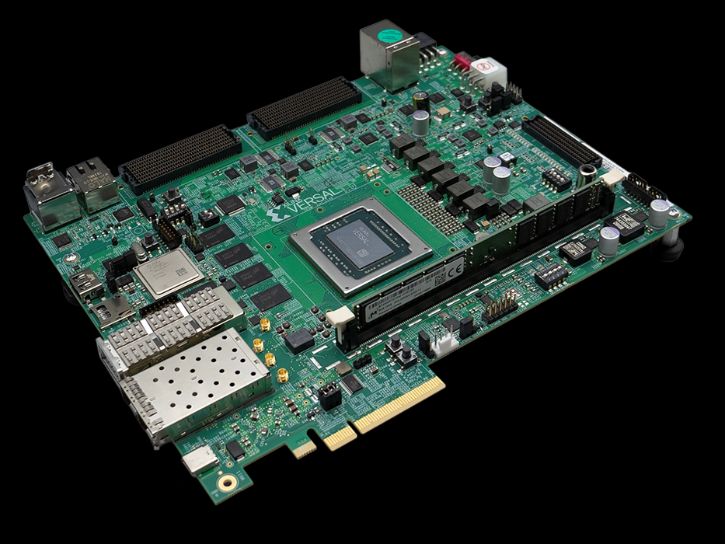

VCK190 套件是首款 Versal AI Core 系列评估套件,支持从云端到边缘实现高吞吐量 AI 推理和信号处理应用,可帮助设计者使用 AI 和 DSP 引擎开发解决方案。

VCK190

VCK5000 Versal 开发卡面向需要高吞吐量 AI 推理和信号处理计算性能的设计,为云加速和边缘计算应用提供了开箱即用的解决方案,无需事先具备 FPGA 硬件专业知识。

VCK5000

结合 Kria KV260 视觉AI 入门套件,这些全新 AI 开发平台能助力客户在 AI 产品化过程中实现卓越的 AI 推断性能、可扩展性和云到边缘的部署选择。

Kria KV260

赋予 AI 产品化更多可能性

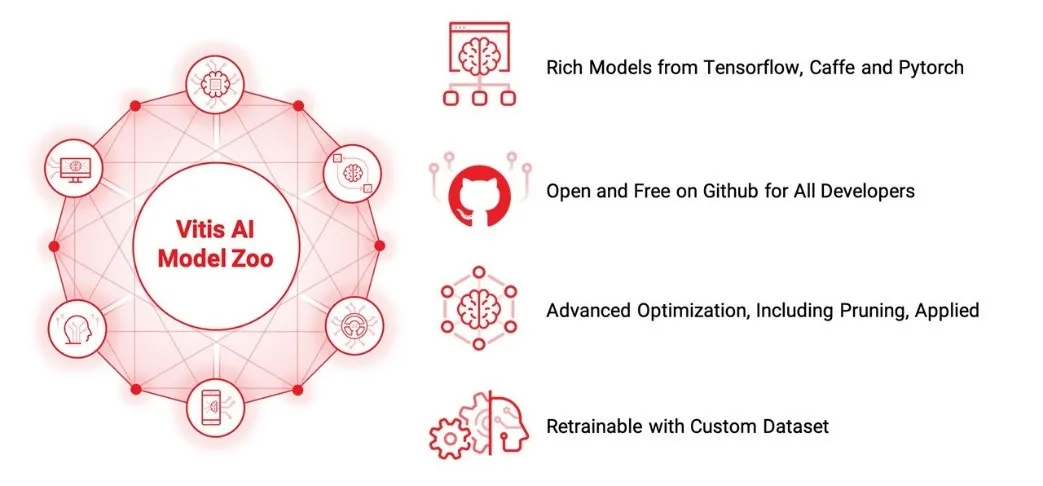

为实现高效 AI 推断加速,AI Model Zoo 的多样性在 Vitis AI 1.4 中进一步增加,可用于 4D 雷达检测、图像激光雷达传感器融合、 环视 3D 检测等领域,包含来自不同 ML 框架的数百个模型。

Vitis AI Model Zoo

通过引入 graph-runner 的全新部署 API,Vitis AI 1.4 为选择直接部署定制神经网络模型的用户提供更加流畅的体验,使定制层在 DPU 和 CPU 上即插即用成为现实。

行业领先的边缘与云端性能

赛灵思 FPGA、自适应 SoC 和 ACAP 所提供的硬件架构可以灵活适应不同场景的计算需求,这既是赢得 AI 产品化之战的最佳方式,也是创建特定领域架构( DSA )诞生的原因。

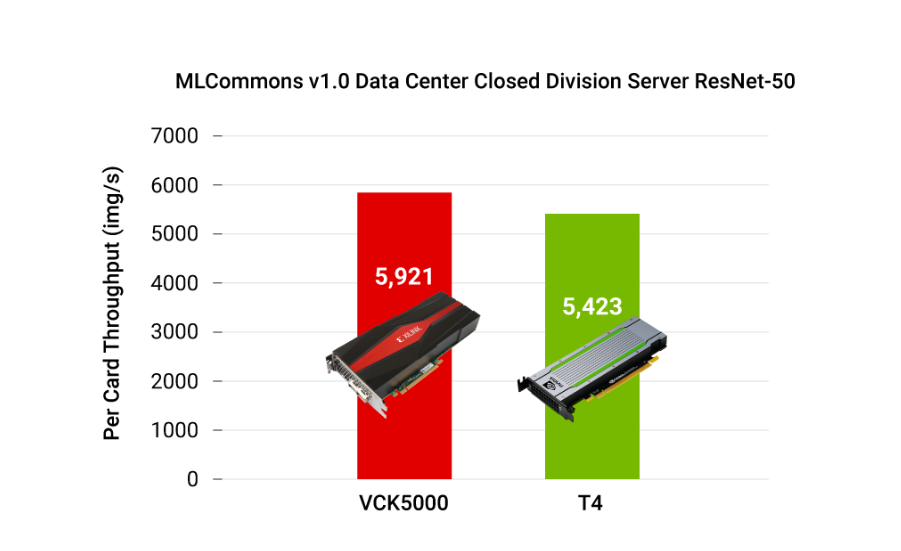

为了证明 DSA 在 AI 推断加速方面的高效性,赛灵思在 MLPerf v1.0 结果中提交了 ResNet-50 封闭 类别基准测试。利用 Versal VCK5000 PCI-E 卡,赛灵思获得了每秒 5,921 张图像( img/s )的结果。相同模式下加速性能优于英伟达 T4卡。

MLCommons v1.0 数据中心封闭类别服务器 ResNet-50 结果

此外,通过利用 AI 引擎( AIE )内核和 DPU 设计、经优化的存储器层级和带宽 IO,VCK190 较之英伟达 AGX Xavier 性能提升了 87% 且时延降低了 19 倍 。借助 Vitis AI 1.4,所有用户通常都可利用 VCK5000 和 VCK190 进行加速。

致力于易使用的软件开发流程

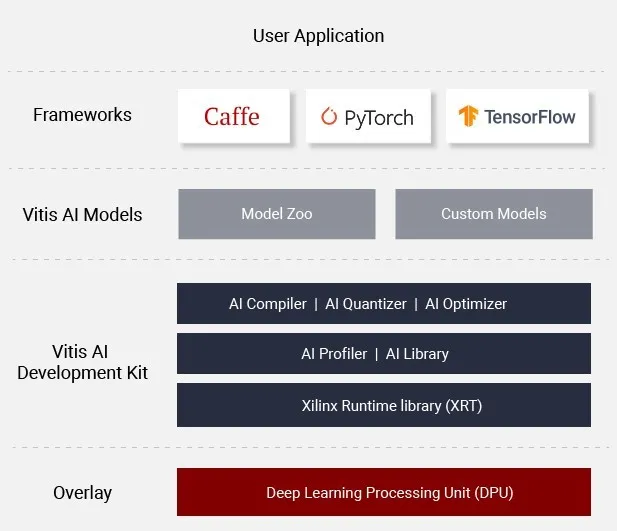

借助 Vitis AI 1.4,量化器、优化器和编译器工具的支持范围均已扩展至最流行的机器学习框架、Pytorch、Tensorflow 1.x、Tensorflow 2.x 和 Caffe。全新 API 和操作员功能也已加入其中,以实现更多 AI 模型跨多个器件的部署。

赛灵思全新 Vitis AI 1.4 开发平台

自赛灵思 Vitis AI 1.0 于 2020 年 1 月发布以来,其下载量已超过 10 万次,并被数百名用户应用于 AI推断。伴随 Vitis AI 1.4 的发布以及支持众多全新功能与模型,开发者可以在全新 Versal AI Core 系列和 Kria SOM 平台上开展更多工作。

欲了解 Vitis AI 1.4 的更多全新特性请访问 china.xilinx.com 或 Github Vitis AI专区